Eine binäre Kooperation ist eine Form arbeitsteiliger Produktentwicklung. Partei A liefert ein kompiliertes Library-Artefakt, Partei B integriert dieses Artefakt in Anwendung, Workflow und UI. Distribuiert wird ein ebenfalls kompiliertes Gesamtprodukt.

Der ökonomische Kern liegt in der Trennung von Benutzbarkeit und Implementierungswissen. Geliefert wird nicht Quelltext, sondern anschlussfähige Funktionalität. Vergütet wird nicht Einsicht in die innere Struktur, sondern die Möglichkeit, ein fremdes Modul kontrolliert in eine eigene Wertschöpfungskette einzubauen.

Teil 1: Die technische Basis – ABI und Opaque Handles

Technisch ist dafür nicht nur eine API relevant, sondern vor allem eine stabile ABI (Application Binary Interface, also die Binärschnittstelle eines bereits kompilierten Moduls). Während eine API die sichtbaren Funktionen und Typen auf Quelltextebene beschreibt, regelt die ABI die tatsächlich relevante Binärverträglichkeit: Aufrufkonventionen, Speicherlayout, Symbolsichtbarkeit, Ownership-Regeln, Fehlertransport und Versionskompatibilität.

Das Opaque-Handle-Pattern ist in diesem Zusammenhang kein Stilmittel, sondern ein Instrument der Kopplungskontrolle. Außen sichtbar ist nur ein undurchsichtiger Handle auf internen Zustand. Außen unsichtbar bleiben Datenlayout, Hilfstypen, Containerwahl und Invarianten. Operationen auf diesem Zustand laufen ausschließlich über exportierte Funktionen. Damit verbleiben Speicherhoheit, Strukturwissen und Refactoring-Freiheit beim Lieferanten.

Das Ergebnis ist eine klare funktionale Aufteilung: Rechenkern auf der einen Seite, UI und Produktkontext auf der anderen. Das begrenzt die technische Angriffsfläche der Kooperation auf eine definierte Binärschnittstelle.

Teil 2: Die offene Plattform – Standards setzen (Open Source)

In der Praxis mündet dieses Architekturmuster fast immer in einem Plugin-System. Es entstehen zwei klare Rollen: Der Host (die Plattform), der Rahmen und Routing stellt, und das Plugin (die Erweiterung), das als dynamische Bibliothek (.so / .dll) exakt die ABI-Schnittstelle bedient.

In der Open-Source-Welt wird der Host oft frei zur Verfügung gestellt, um einen Standard zu etablieren. Bekannte Beispiele finden sich dort, wo klare Schnittstellen auf hochspezialisierte Anforderungen treffen: Der populäre Netzwerkanalysator Wireshark bindet komplexe oder proprietäre Protokoll-Parser (Dissectors) als dynamische .so-Bibliotheken tief in seine Engine ein. Auf dem modernen Linux-Desktop lädt der performante Wayland-Compositor Hyprland neue Fenster-Management-Regeln als native Binär-Plugins direkt in seinen Kern. Und auch im hochskalierenden Web-Bereich greift dieses Muster: Der Webserver Nginx erlaubt es, rechenintensive Filter oder Security-Regeln von Drittanbietern als nativ kompilierte Dynamic Modules direkt in die Verarbeitungspipeline einzuhängen.

Das Geschäftsmodell hier: Die offene Kern-Plattform gewinnt massive Marktanteile, während spezialisierte Firmen kommerzielle, proprietäre Module in dieses Ökosystem verkaufen können.

Teil 3: Das doppelte Geheimnis – Industrielle Maßstäbe (Closed Source)

Das Prinzip der ABI-Kooperation entfaltet sich besonders ausgeprägt im rein proprietären (Closed-Source) Sektor. Hier greift das Prinzip der gegenseitigen IP-Abschirmung: Der Host-Entwickler gibt ausschließlich eine C/C++ Header-Datei (die ABI-Dokumentation) heraus. Es gibt keinen Quellcode – beide Seiten kommunizieren als kompilierte Blackboxen miteinander.

Dieses Modell sichert in der Industrie gigantische Märkte ab:

-

Kreativindustrie (Audio/Video): Ein historisches Paradebeispiel ist die Musik-Software Cubase von Steinberg. Die Software ist strikt Closed Source, etablierte aber die VST-Schnittstelle (Virtual Studio Technology). Steinberg kennt die Mathematik fremder Audio-Filter nicht, und die Filter-Entwickler kennen Steinbergs Audio-Engine nicht. Sie tauschen über Opaque Pointers lediglich Audio-Puffer aus. So entstand ein Milliardenmarkt für Drittanbieter-Plugins.

-

Automotive & Simulation: In der Fahrzeugentwicklung nutzen Hersteller und Zulieferer den FMI-Standard (Functional Mock-up Interface). Wenn ein Autokonzern eine Fahrzeug-Simulation in einem geschlossenen Host-System (wie MATLAB/Simulink) baut, übergibt ein Getriebehersteller sein mathematisches Modell lediglich als vorkompilierte Binärdatei (FMU). Die Host-Simulation füttert das Plugin via C-ABI mit Drehzahl und Temperatur und erhält physikalische Ergebnisse zurück. Die streng geheimen Reibungs-Algorithmen des Zulieferers bleiben unangetastet.

-

Finanzwesen: Institutionelle Trading-Plattformen wie MetaTrader erlauben es, Analyse-Werkzeuge und Trading-Strategien als native .dll-Dateien einzubinden. Zu beachten ist dabei, dass MetaTrader primär eine eigene Skriptsprache (MQL4/5) anbietet; native DLLs sind eine ergänzende Erweiterungsoption für rechenintensive oder besonders schützenswerte Logik. Die Plattform leitet Börsendaten an das Plugin weiter; nach welcher geheimen Strategie der Bot kauft oder verkauft, bleibt das exklusive Firmengeheimnis des Drittanbieters.

Fazit: Das Plugin als wirtschaftliches und juristisches Schutzschild

Egal ob in einer quelloffenen Plattform oder in einer geschlossenen Industrie-Simulation: Ein Drittanbieter kann ein hochkomplexes, proprietäres Verfahren verkaufen, ohne sein Intellectual Property (IP) jemals im Quelltext offenzulegen.

Ein absoluter Schutz vor Reverse-Engineering ist eine bloße Binärdatei technisch zwar nicht – Tools wie Decompiler können Maschinencode wieder in Assembler übersetzen. Doch wirtschaftlich und juristisch reicht die Barriere meist aus: Das Zurückgewinnen hochoptimierter Mathematik aus maschinellen Registern ist ein extremer, oft unrentabler Aufwand. Zudem etabliert die Binärdatei eine klare juristische Grenze (Trade Secret), deren Brechen den Straftatbestand der Industriespionage erfüllt. Wo das nicht reicht, wird die Binärschnittstelle zusätzlich mit hardwarebasiertem DRM oder Code-Virtualisierung (Packer) versiegelt.

Die Kosten dieses Architektur-Modells sind hoch: Erhöhter Aufwand bei Debugging, strengste Anforderungen an Versionierung und null Toleranz für unsauberes Speichermanagement. Im Gegenzug entsteht jedoch ein extrem belastbares Ökosystem, in dem Implementierungskapital (der geheime Algorithmus) und Distribution (die Host-Plattform) völlig unabhängig voneinander skalieren und monetarisiert werden können.

Teil 4: Vereinfachende Standards – Alternativen zur rohen C-ABI

Frage: Gibt es vereinfachende Standards, die denselben IP-Schutz bieten wie die in Teil 3 beschriebene C-ABI, aber mit weniger Fehleranfälligkeit?

Die rohe C-ABI ist mächtig, aber gefährlich: Ein falsch verwalteter Pointer, ein Versionskonflikt beim Compiler oder eine unterschiedliche Calling Convention genügen, um das gesamte System zum Absturz zu bringen. Die Industrie hat auf diesen Schmerz reagiert und mehrere Abstraktionsschichten entwickelt, die denselben IP-Schutz bieten – mit deutlich sanfteren Kosten.

WebAssembly (WASM) + WASI

Das ist der aktuell stärkste Trend für neue Systeme. Das Plugin wird zu .wasm kompiliert und läuft in einer sandboxed virtuellen Maschine – vollständig plattformunabhängig, ohne geteilten Adressraum, ohne Speicherverwaltungsprobleme zwischen Host und Plugin. Der Host kontrolliert exakt, welche Ressourcen das Plugin sehen darf (Filesystem, Netzwerk, Systemaufrufe). Frameworks wie Extism bauen darauf auf und liefern ein generisches Plugin-System, das in nahezu jeder Host-Sprache funktioniert. IP-Schutz: WASM-Bytecode ist deutlich schwerer zu reverse-engineeren als natives x86, kein absoluter Schutz, aber eine höhere Hürde als eine nackte .so. Der Preis ist Laufzeit-Overhead durch die VM – für Echtzeit-Audio oder physikalische Simulation heute noch zu teuer, für alles andere zunehmend akzeptabel.

COM / DCOM (Windows-Welt)

Microsofts Component Object Model löst seit den 1990ern exakt dieses Problem: typsichere, versionierte Binärschnittstellen ohne Quellcode, mit definiertem Ownership-Modell (AddRef/Release) und maschinenlesbaren Interface-Beschreibungen (IDL/TLB). VST3 von Steinberg – der direkte Nachfolger der in Teil 3 beschriebenen VST-Schnittstelle – baut auf COM-ähnlichen Prinzipien auf und ist damit ein direktes Beispiel für die Ablösung der rohen C-ABI durch einen formalisierteren Standard im selben Ökosystem. Der Preis: primär Windows-zentriert, und das Objektmodell trägt historischen Ballast.

gRPC / Protobuf über lokalen Socket

Kein ABI-Ansatz im klassischen Sinne, aber in der Praxis weit verbreitet: Das Plugin läuft als eigenständiger Prozess, die Kommunikation erfolgt über ein maschinenlesbares Schema (.proto-Datei). Vollständige Sprachunabhängigkeit, triviales Versionieren über Feldnummern, automatisch generierte Clients und Server in Dutzenden Sprachen. IP-Schutz ist maximal – der Plugin-Prozess ist eine vollständige Blackbox. Für die Finanzwelt (MetaTrader-Szenario aus Teil 3) ist das ein realistischer Ansatz: Latenz im Sub-Millisekunden-Bereich ist dort weniger kritisch als bei Echtzeit-Audio. Für FMI-Simulation oder VST-Audio scheidet dieser Ansatz jedoch aufgrund der Prozess-Kommunikationskosten aus.

Bewertungsmatrix

| Standard |

Plattform |

Latenz |

Versionierung |

RE-Schutz |

Komplexität |

| Rohe C-ABI |

Überall |

Minimal |

Manuell, fehleranfällig |

Mittel |

Hoch |

| WASM + WASI |

Überall |

Gering |

Gut |

Hoch |

Mittel |

| COM / VST3 |

Windows-nah |

Minimal |

Formalisiert |

Mittel |

Mittel |

| gRPC / Protobuf |

Überall |

Moderat |

Sehr gut |

Sehr hoch |

Niedrig |

Der Trend geht für neue Systeme klar Richtung WASM. Für latenz-kritische Industrieanwendungen – FMI-Simulation, VST-Audio, Automotive-Echtzeit – bleibt die C-ABI jedoch noch auf absehbare Zeit der Goldstandard. Kein vereinfachender Standard überwindet die grundlegende Physik: Wer nanosekunden-genaue Übergabe von Audiodaten oder Differentialgleichungen braucht, zahlt den Preis der rohen Schnittstelle.

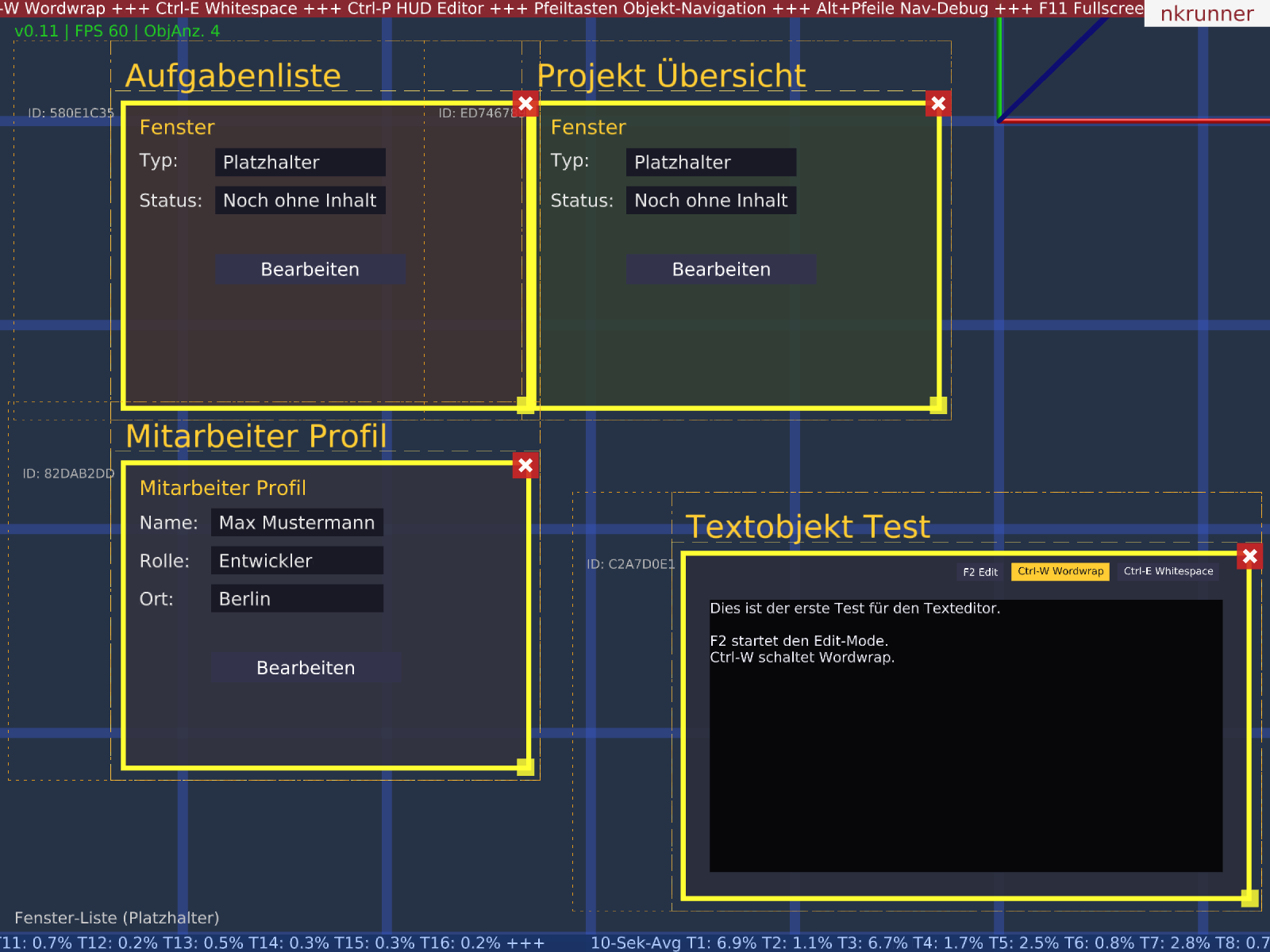

Abb 1: Die neuen Boundaries schließen das eigentliche Frame und die dazugehörige Caption in eine gemeinsame Bounding-Box ein.

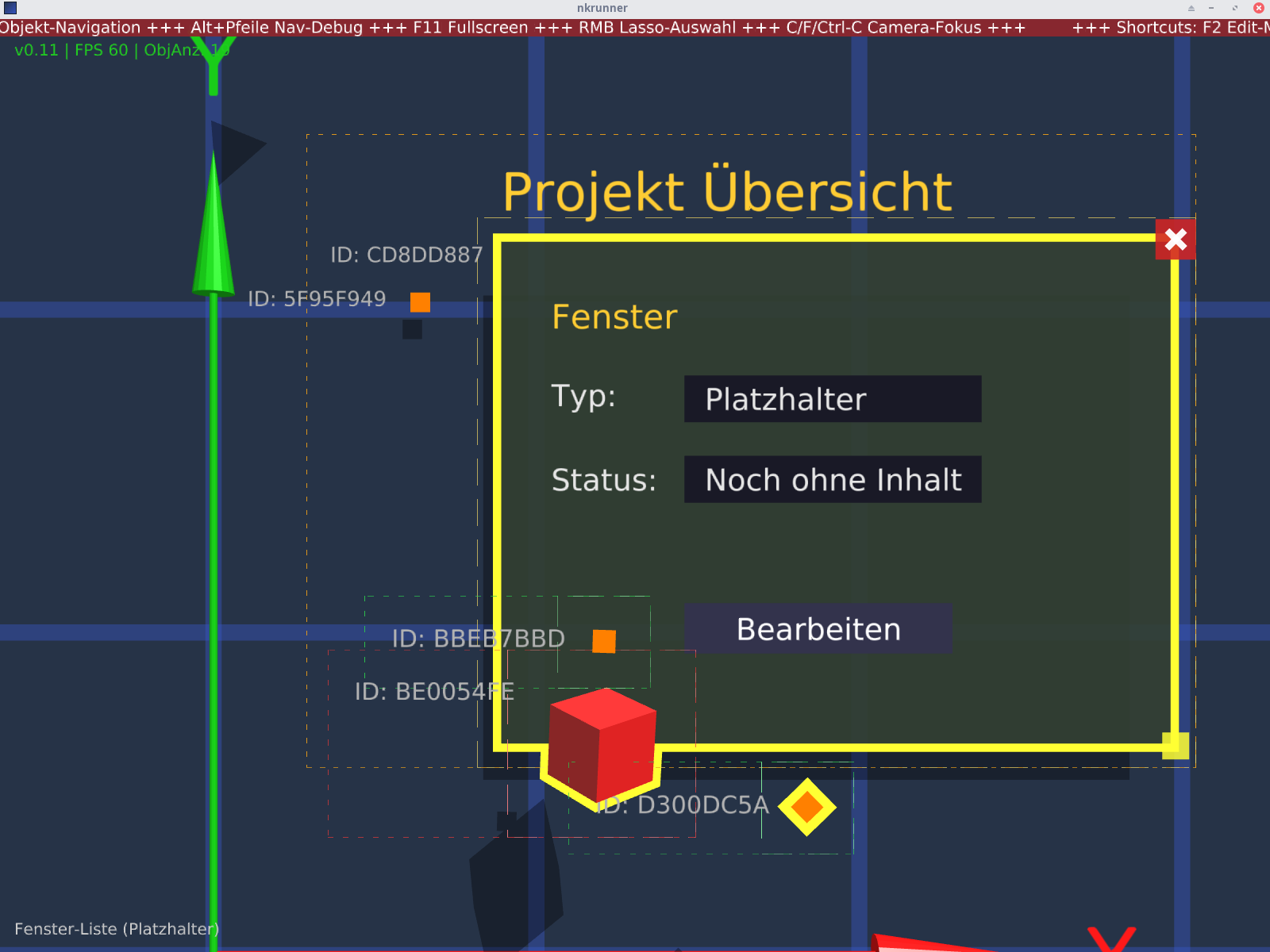

Abb 1: Die neuen Boundaries schließen das eigentliche Frame und die dazugehörige Caption in eine gemeinsame Bounding-Box ein. Abb 1: Die aktuelle Testumgebung im nkrunner mit Fokus auf Fensterverwaltung und Rendering.

Abb 1: Die aktuelle Testumgebung im nkrunner mit Fokus auf Fensterverwaltung und Rendering. Abb 1: Die Spatial UI beim Selektieren und Verschieben von massiven Objektmengen.

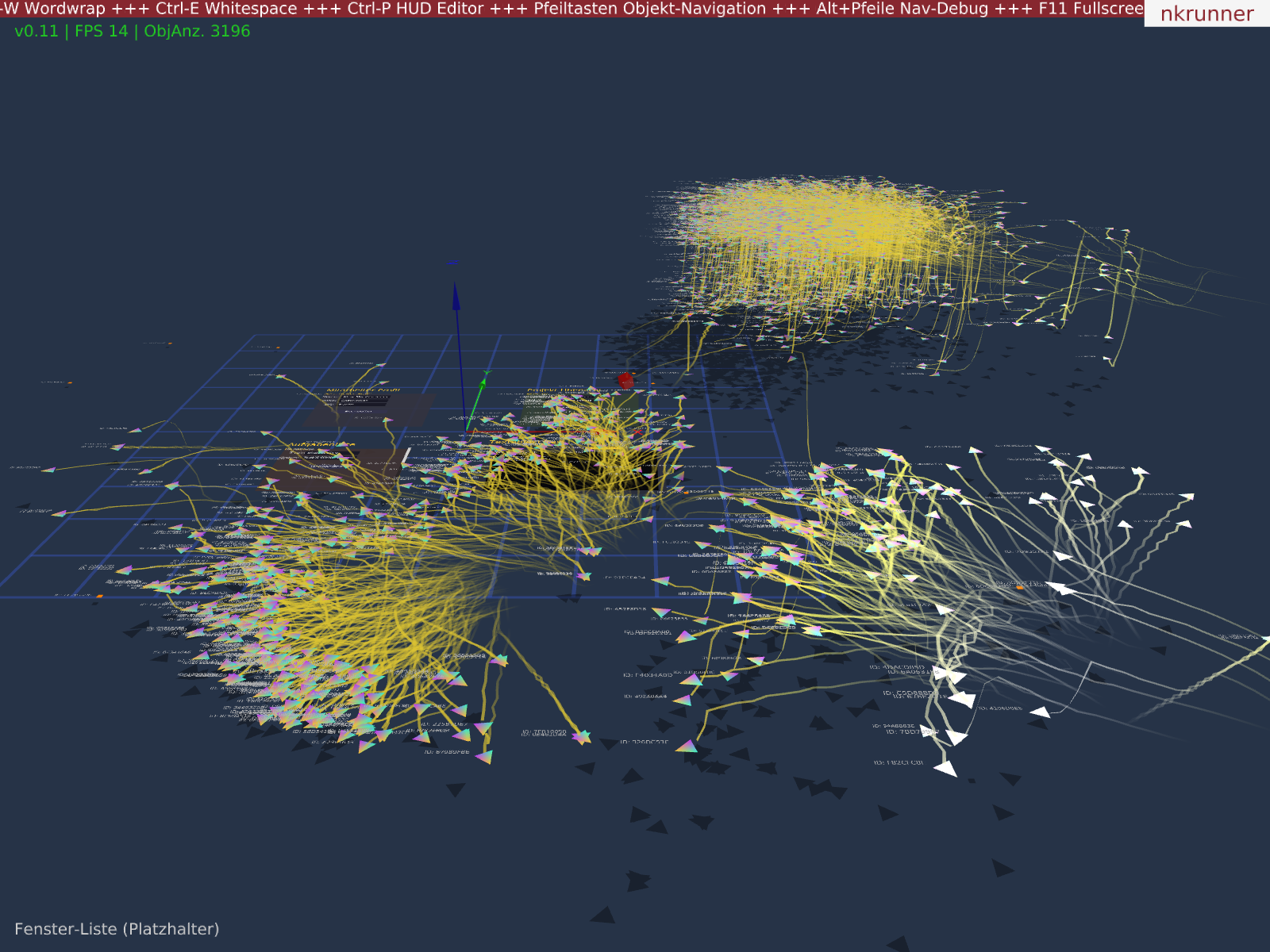

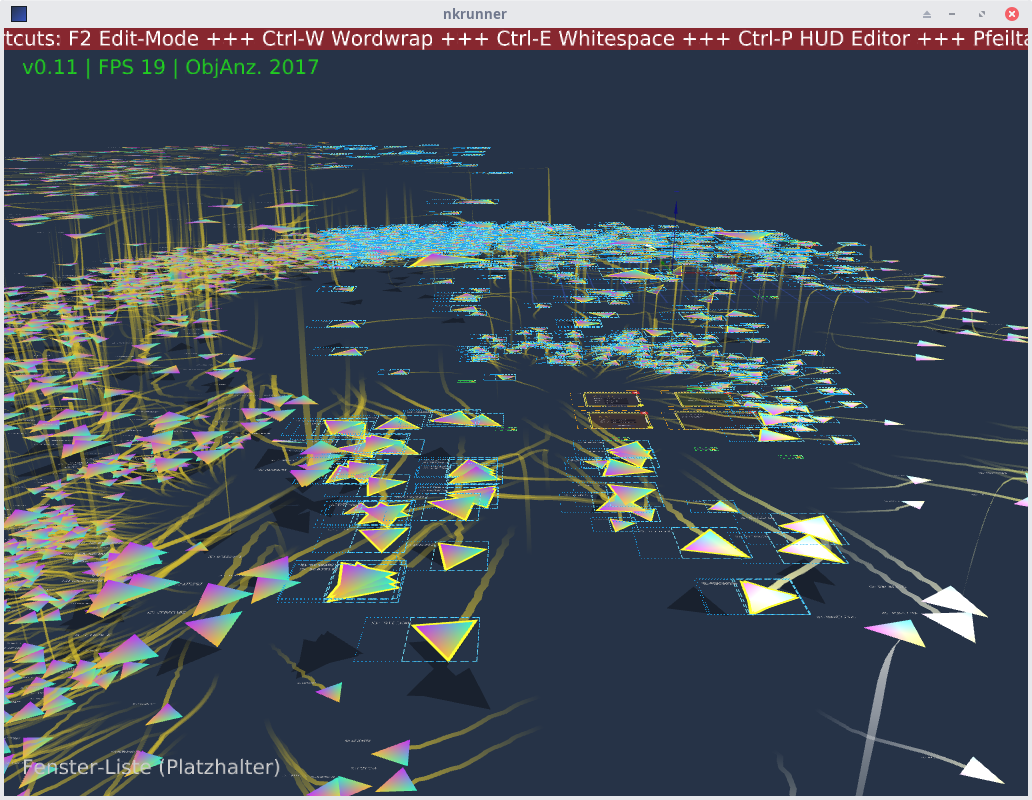

Abb 1: Die Spatial UI beim Selektieren und Verschieben von massiven Objektmengen. Abb 1: Die Engine bei über 2000 aktiven Render-Objekten.

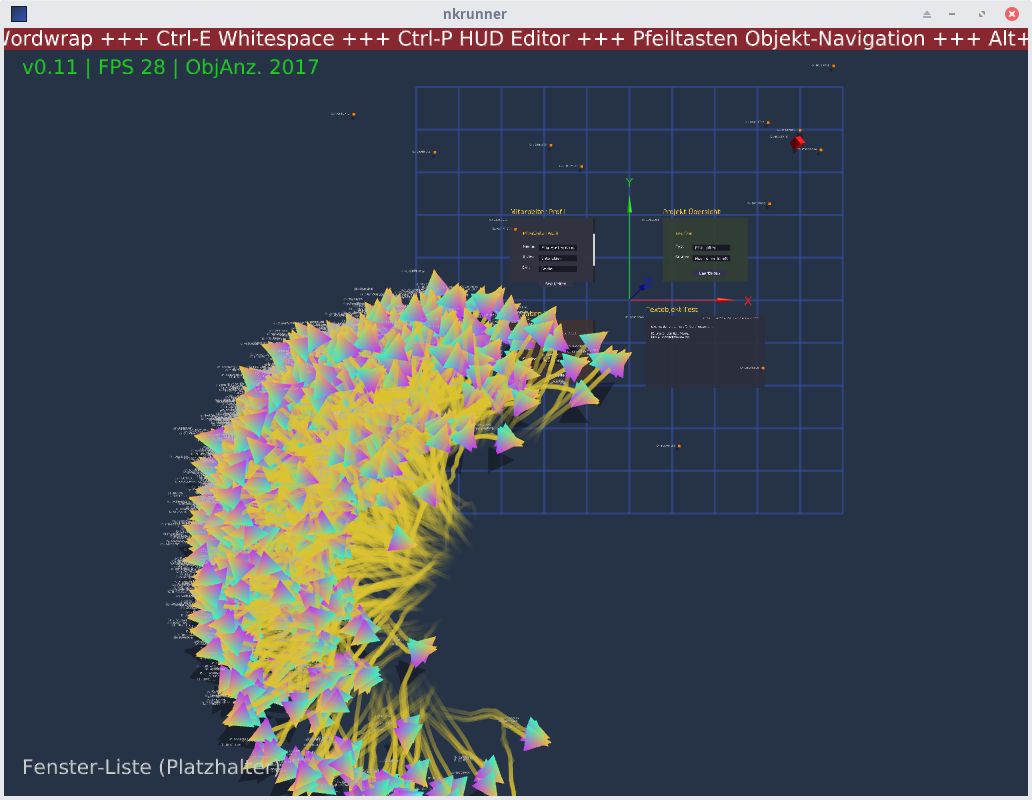

Abb 1: Die Engine bei über 2000 aktiven Render-Objekten. *Abb 2: Auch bei hoher Last auf der integrierten Grafik

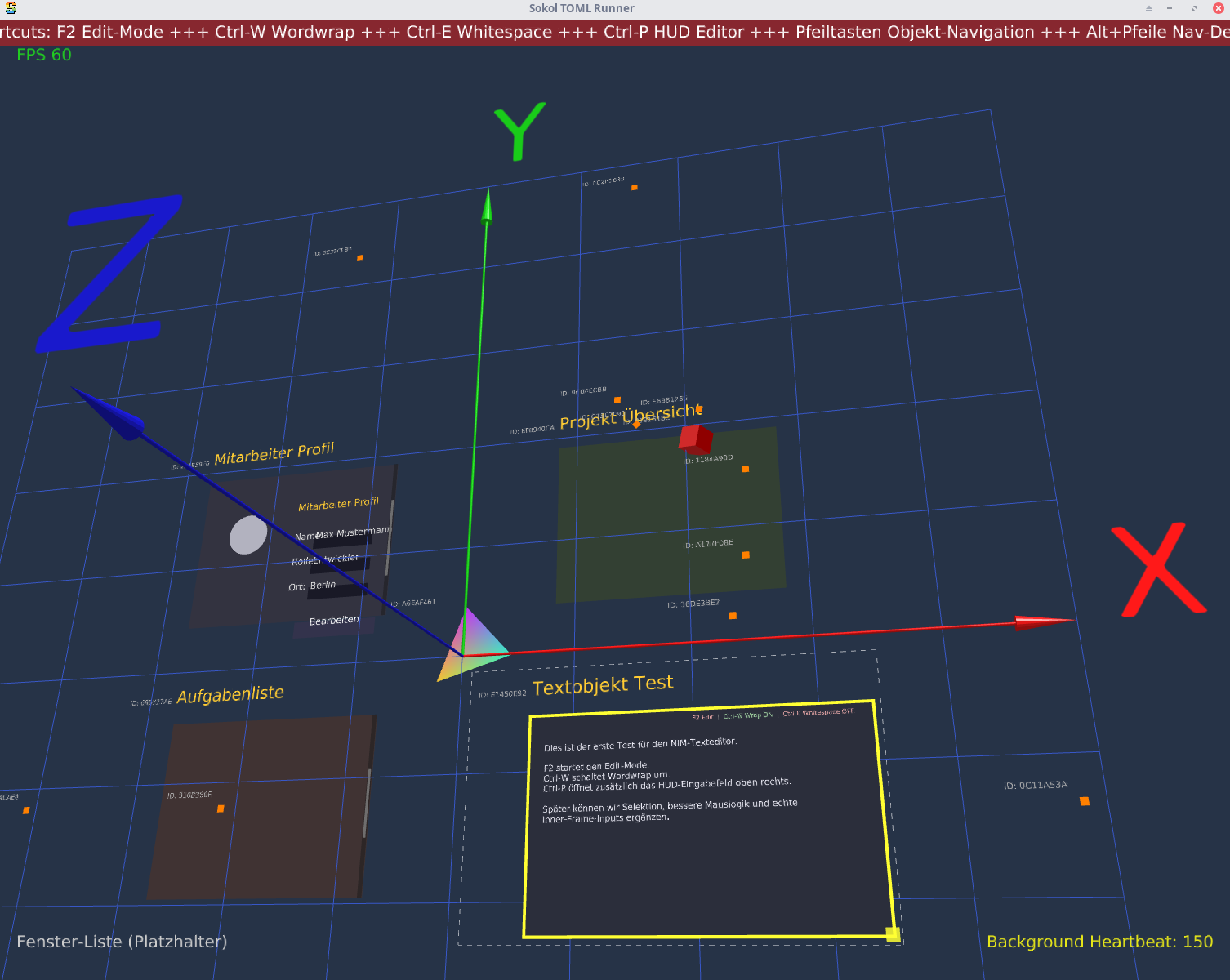

*Abb 2: Auch bei hoher Last auf der integrierten Grafik Abb 1: Unsere räumliche Benutzeroberfläche mit aktiven Text-Modulen, Selektions-Pfeilen und globalem Koordinatensystem.

Abb 1: Unsere räumliche Benutzeroberfläche mit aktiven Text-Modulen, Selektions-Pfeilen und globalem Koordinatensystem.